Kling AI Bild zu Video 2026: jedes Standbild mit realistischer Bewegung animieren

Kling AI Bild-zu-Video Guide 2026: Fotos, Produktbilder und Illustrationen animieren. Motion Hints, Qualitätstipps, Anwendungsfälle und Workflow für Creator.

- Kling AI Bild-zu-Video animiert ein statisches Bild in einen kurzen Videoclip mit physikalisch korrekter Bewegung.

- Die Qualität des Quellbilds ist entscheidend: scharfe, gut belichtete, klare Kompositionen liefern bessere Animation als komprimierte oder überladene Bilder.

- Motion Hints im Prompt steuern, wie Motiv und Kamera sich bewegen — ohne Hints wendet Kling eine Standard-Bewegung an, die möglicherweise nicht deiner Absicht entspricht.

- Ideal für: Produktfotos, Portraits, Illustrationen, KI-generierte Bilder und vorhandene Markenfotografie animieren.

Wie Kling AI Bild zu Video funktioniert

Kling AI Bild-zu-Video nimmt ein statisches Bild als Eingabe und generiert einen 5 oder 10-sekündigen Videoclip, in dem sich Motive, Umgebung und Kamera physikalisch kohärent bewegen. Das Modell bewahrt den visuellen Stil, die Farbbehandlung und die Komposition des Quellbilds und fügt Bewegung hinzu, die die implizite Physik der Szene respektiert.

Der Kernvorteil gegenüber Text-zu-Video für diesen Anwendungsfall ist Konsistenz. Wenn du von einem Bild ausgehst, sind das Aussehen des Motivs, die Beleuchtung und die Umgebung bereits definiert. Das Modell muss keine Beschreibung interpretieren — es hat direkte visuelle Referenz. Dadurch ist Bild-zu-Video zuverlässiger, um Bewegung um ein spezifisches vorhandenes Asset zu generieren.

Die wichtigsten Eingabevariablen sind: die Qualität des Quellbilds, der Motion-Hint-Text und die Dauer-Einstellung.

Beste Quellbilder für die Kling AI Animation

Nicht alle Bilder produzieren gleich gute Animationen. Die Eigenschaften deines Quellbilds beeinflussen die Ausgabequalität erheblich.

Bilder, die gut funktionieren:

- Saubere, gut belichtete Kompositionen — Ein einzelnes Motiv vor einem klaren Hintergrund produziert die kohärenteste Animation. Das Modell handhabt Tiefe und Bewegung besser, wenn die Motivgrenze eindeutig ist.

- Hohe Auflösung — Lade die höchstauflösende Version hoch. Upscaling-Artefakte im Quellbild erscheinen in der animierten Ausgabe.

- Klare implizierte Bewegung — Bilder, wo das Motiv in Bewegung zu sein scheint (Person auf halbem Schritt, Wasser kurz vor dem Fall, Tänzer in einer Pose) geben dem Modell starke Hinweise, welche Bewegung vervollständigt werden soll.

- Konsistente Beleuchtung — Gleichmäßige, realistische Beleuchtung animiert natürlicher als künstliche, flache oder übermäßig komplexe Lichtsetups.

- KI-generierte Bilder — Bilder aus DALL-E, Midjourney, Stable Diffusion oder ähnlichen Tools animieren oft hervorragend, weil sie für visuelle Klarheit und Komposition optimiert sind.

Bilder, die inkonsistente Ergebnisse liefern:

- Stark komprimierte JPEGs mit sichtbaren Artefakten

- Bilder mit mehreren Motiven in komplexen Arrangements

- Hintergründe mit dichtem Detail, das Tiefenmehrdeutigkeit erzeugt

- Gesichter in scharfem Winkel oder mit starker Verzerrung aufgenommen

Motion Hints für Bild-zu-Video schreiben

Motion Hints sind kurze Textbeschreibungen, die du neben dem Quellbild angibst. Sie steuern, wie das Modell die Szene animiert — ohne Hints wendet Kling ein Standard-Bewegungsmuster an, das möglicherweise nicht deiner kreativen Absicht entspricht.

Struktur eines nützlichen Motion Hints:

[Motivaktion] + [Kamerabewegung] + [Umgebungsbewegung]

Beispiele nach Anwendungsfall:

Produktfotografie: "Produkt dreht sich langsam im Uhrzeigersinn, Kamera schiebt sanft zum Etikett hin, weicher Bokeh-Hintergrund bleibt still."

Portrait oder Charakter: "Motiv dreht den Kopf langsam von links nach rechts, Augen blinzeln natürlich, Haare bewegen sich leicht wie in einer leichten Brise, Kamera statisch."

Landschaft oder Umgebung: "Sanfte Brise bewegt Gras und Baumblätter von links nach rechts, Wolken treiben langsam über den Himmel, Kamera zieht langsam zurück, um eine breitere Szene zu enthüllen."

Abstrakt oder künstlerisch: "Farben fließen und verschmelzen in langsamer, organischer Bewegung, Formen atmen sanft, Kamera statisch."

Bewegungsintensitätsstufen:

- "Subtil", "sanft", "langsam" → minimale Bewegung, gut für Produktfotos und formelle Portraits

- "Moderat", "natürlich" → Standard-Animationsgeschwindigkeit

- "Dynamisch", "dramatisch", "schnell" → starke Bewegung, besser für Action oder energiegeladene Inhalte

Spezifiziere immer die Intensität, es sei denn, du möchtest, dass das Modell entscheidet. Unkontrollierte Intensität produziert oft übermäßig dramatische oder komisch übertriebene Bewegung für Szenen, die ruhig sein sollten.

Anwendungsfälle für Kling AI Bild-zu-Video

E-Commerce Produktanimation — Animiere ein Produktfoto für einen kurzen Social-Media-Clip oder eine Anzeige. Eine Flasche, die sich langsam dreht, die Textur eines Schuhs, die beim Drehen Licht einfängt, oder Kleidungsstoff, der sich natürlich bewegt. Das ist einer der ROI-stärksten Einsätze von Bild-zu-Video für Marken, die bereits Produktfotografie haben.

KI-Kunst animieren — Wenn du Bilder mit Midjourney, DALL-E oder Stable Diffusion generierst, fügt das Animieren mit Kling Bewegung hinzu, die statische Kunst in teilbaren Video-Content verwandelt. Funktioniert besonders gut für Fantasy, Sci-Fi und künstlerische Motive, wo stilisierte Bewegung die Ästhetik verstärkt.

Portrait und Charakter-Video — Animiere ein Charakter-Portrait für Spieleentwicklung, Social Media, Avatar-Content oder kreative Projekte. Ein gemalter Charakter, der zum Leben erwacht, die Idle-Animation eines Spielcharakters, oder ein fiktiver Charakter, der seinen Ausdruck zeigt.

Thumbnail-Animation — Verwandele ein YouTube-Thumbnail-Design in einen kurzen animierten Clip für den Shorts-Feed, Twitter oder Vorschau-Content. Das wiederverwendet vorhandene visuelle Assets, ohne neue von Grund auf zu generieren.

Vorher/Nachher-Enthüllungen — Animiere ein "Vorher"-Bild, um zu einem implizierten "Nachher"-Zustand zu transitionen: eine Renovierung, eine Transformation oder ein Prozessabschluss. Die Bewegung erzeugt visuelles Interesse ohne vollständige Videoproduktion.

Demos aus der Galerie:

Hier sind vier echte Kling Bild-zu-Video Ausgaben aus diesem Guide. Jede wurde aus einem Quellbild mit einem Motion Hint generiert:

Quelle: Portrait-Standbild — Motion Hint: natürliche Kopfbewegung und Blinzeln

Quelle: Katzenportrait — Motion Hint: subtiles Atmen und Ohrenbewegung

Quelle: Fantasy-Illustration — Motion Hint: langsame Flügelbewegung und Atmosphärendunst

Quelle: abstrakte Kunst — Motion Hint: langsame Rotation und Lichtbloom

Diese Demos zeigen die Bandbreite von Bild-zu-Video: von realistischen Portraits über Fantasy-Illustrationen bis zur abstrakten Kunst. Jede animiert mit Bewegung, die die visuelle Logik des Quellbilds respektiert.

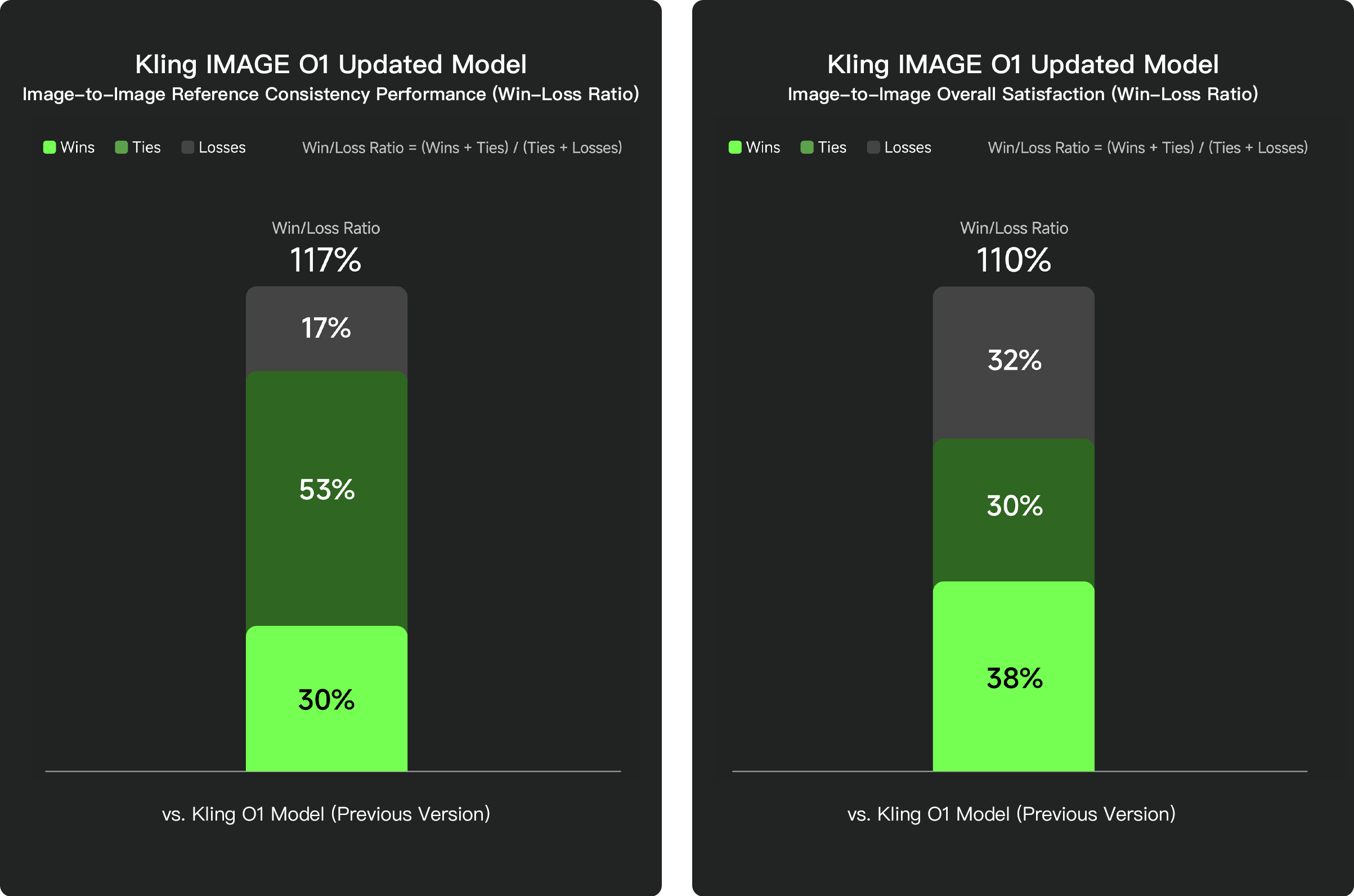

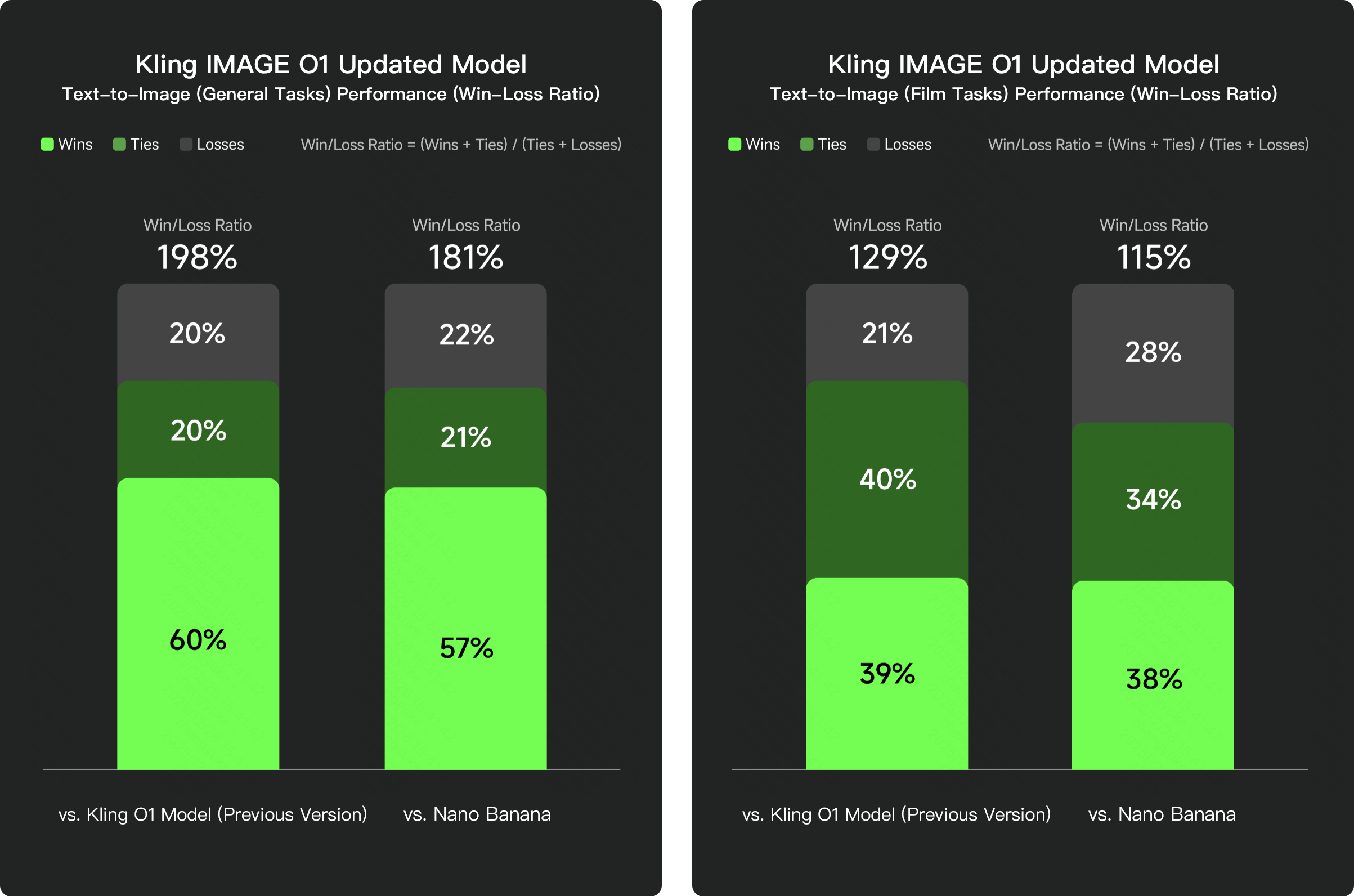

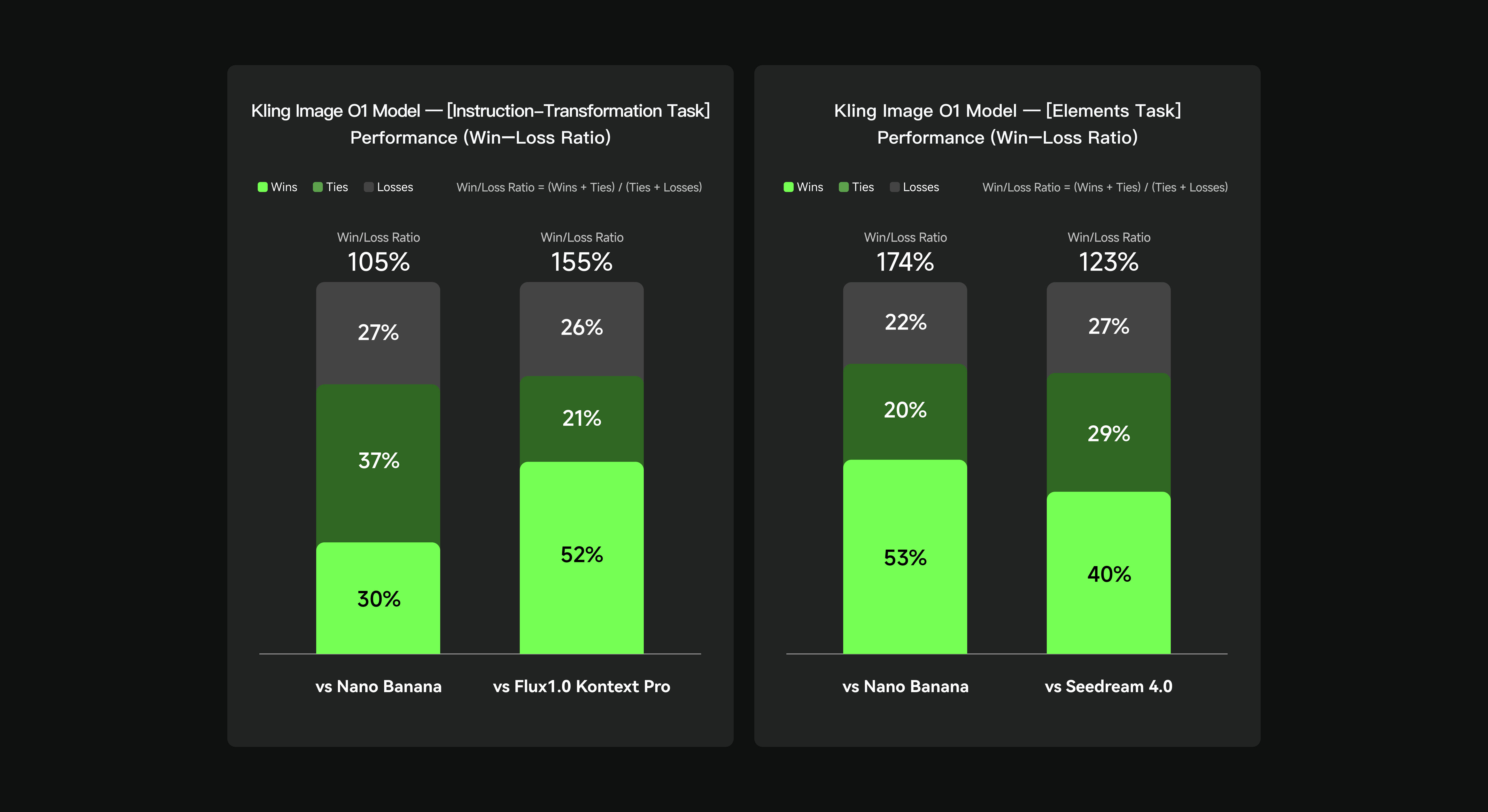

Leistung des Kling IMAGE O1 Modells

Das IMAGE O1 Updated Model zeigt signifikante Verbesserungen bei Bild-zu-Bild-Konsistenz und Gesamtzufriedenheit gegenüber dem vorherigen Kling O1 Baseline:

Diese Benchmark-Zahlen spiegeln die Modellleistung zum Zeitpunkt der IMAGE O1 Updated Veröffentlichung wider. Sie bestätigen, dass Klings Bildgenerierungsschicht — die direkt die Bild-zu-Video-Qualität beeinflusst — messbar gegenüber konkurrierenden Modellen bei allgemeinen und kinematischen Aufgaben verbessert hat.

Lade ein Quellbild hoch und animiere es mit Kling AI — kostenlose Credits für den ersten Test verfügbar.

Kling AI testenFAQ

Welche Bildformate akzeptiert Kling AI für Bild-zu-Video?

Kling akzeptiert JPEG und PNG. Verwende hochauflösende, gut belichtete Bilder für beste Ergebnisse.

Kann ich die Bewegungsrichtung bei Bild-zu-Video steuern?

Ja. Verwende Motion-Hint-Text, um anzugeben, wie sich Motiv oder Kamera bewegen sollen: 'Motiv dreht den Kopf langsam nach rechts', 'Kamera schiebt sanft vorwärts', 'Blätter wehen von rechts nach links'.

Wie unterscheidet sich Bild-zu-Video von Text-zu-Video in Kling?

Bild-zu-Video animiert eine bestehende Komposition — Motiv, Beleuchtung und Stil sind bereits durch das Quellbild definiert. Text-zu-Video generiert die Komposition von Grund auf aus deiner Beschreibung.